Un jurado en Nuevo México concluyó que la empresa engañó a las personas usuarias sobre la seguridad de sus plataformas y habilitó entornos propicios para el contacto con abusadores. El fallo podría marcar un punto de inflexión en la responsabilidad legal de las plataformas digitales.

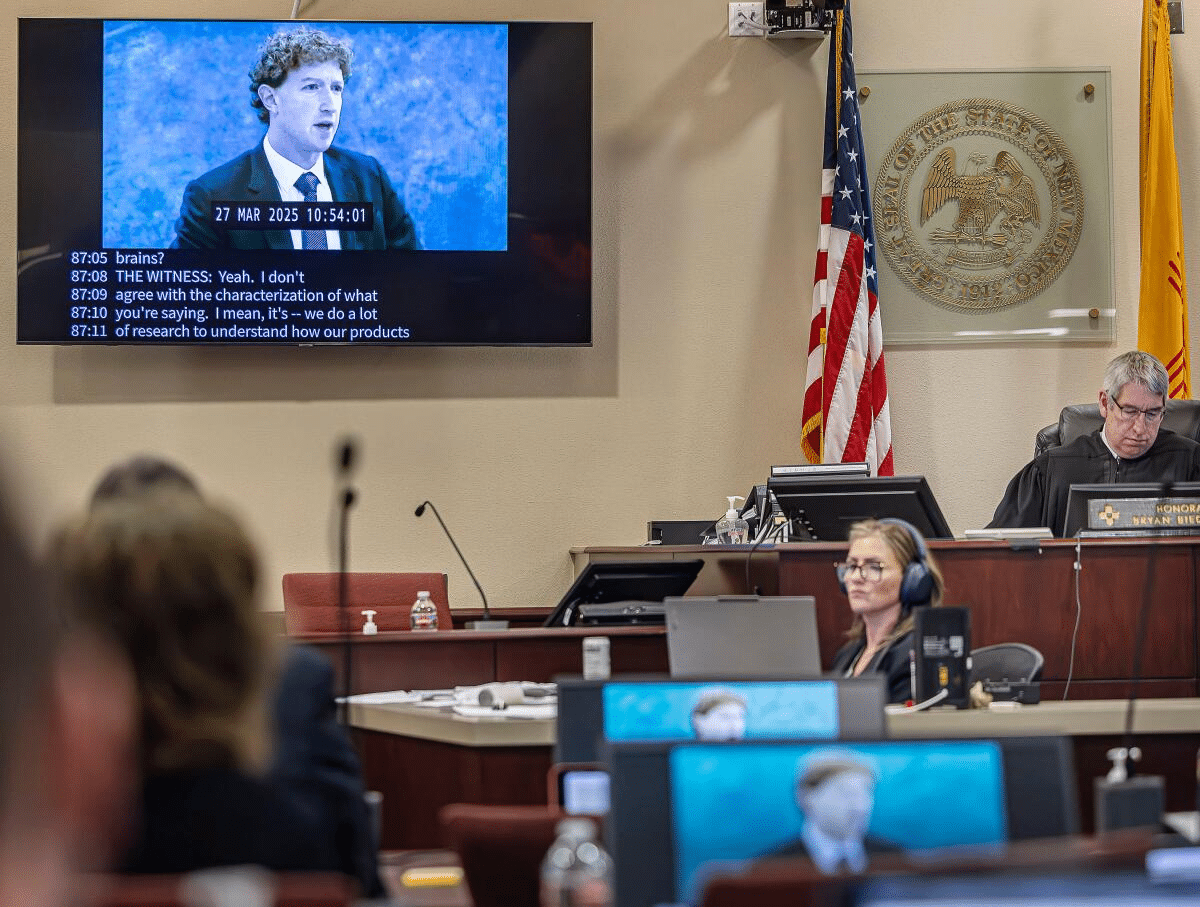

Un jurado estatal en Nuevo México ordenó a Meta pagar 375 millones de dólares en daños civiles tras determinar que la compañía violó de forma deliberada las leyes de protección al consumidor y engañó a las personas usuarias sobre la seguridad de sus plataformas. El caso, impulsado por el fiscal general Raúl Torrez en 2023, se centró en los riesgos que enfrentan niños, niñas y adolescentes en entornos como Facebook e Instagram.

La demanda se apoyó en una investigación encubierta en la que se creó un perfil falso de una niña de 13 años. Según la acusación, ese perfil fue rápidamente expuesto a imágenes y solicitudes dirigidas por parte de abusadores, lo que evidenció fallas estructurales en los sistemas de la empresa para prevenir este tipo de interacciones.

El jurado consideró probado que Meta no solo incumplió sus obligaciones legales, sino que además presentó de forma engañosa sus mecanismos de seguridad. En ese sentido, el fallo no se limita a evaluar contenidos específicos, sino que apunta a la arquitectura misma de las plataformas y a las decisiones de diseño que facilitan la circulación y amplificación de riesgos.

Este punto resulta central. Durante años, las grandes plataformas han logrado evitar responsabilidades legales invocando la Sección 230 de la legislación estadounidense, que las protege frente a los contenidos publicados por terceros. Sin embargo, el caso de Nuevo México introduce una estrategia distinta: en lugar de cuestionar publicaciones individuales, se pone en foco el funcionamiento de los sistemas de recomendación, la lógica algorítmica y los incentivos del modelo de negocio.

La hipótesis es que los daños no derivan de un contenido aislado, sino de un diseño que promueve la exposición reiterada a determinados materiales o interacciones. En el caso analizado, esto incluye la capacidad de los algoritmos para identificar patrones de comportamiento y reforzarlos, incluso cuando implican riesgos para personas menores de edad.

El fiscal Torrez fue explícito en este sentido al señalar que el objetivo es modificar las características de diseño de estos productos, no solo sancionar conductas puntuales. Según sostuvo, establecer estándares a nivel estatal podría tener efectos más amplios, incluso a escala internacional.

Meta, por su parte, rechazó el veredicto y anunció que apelará la decisión. Un vocero de la empresa afirmó que la compañía trabaja activamente para proteger a las personas usuarias, aunque reconoció las dificultades para identificar y eliminar actores dañinos en entornos digitales complejos.

El caso de Nuevo México es el primero de una serie de litigios contra plataformas digitales que llega a juicio. En paralelo, un tribunal en Los Ángeles analiza si empresas como Meta y YouTube conocían los efectos perjudiciales de sus productos sobre la salud mental de personas jóvenes. Otras compañías, como TikTok y Snap, optaron por acuerdos extrajudiciales en ese proceso.

Más allá del resultado final de las apelaciones, el fallo introduce un precedente relevante: refuerza la idea de que la responsabilidad de las plataformas no puede limitarse al contenido, sino que debe incluir el diseño, la arquitectura y los incentivos económicos que estructuran la experiencia digital.

0 comentarios